Realita Bengkulu – Tim peneliti Google memperkenalkan teknologi bernama TurboQuant, sebuah inovasi yang mengubah cara kecerdasan buatan mengelola data dengan lebih efisien. Teknologi ini dirancang untuk membuat sistem AI lebih ringkas tanpa mengorbankan kemampuan intelijen mereka, menciptakan solusi yang hampir paradoks dalam dunia teknologi modern.

Penemuan ini menarik perhatian karena menunjukkan arah baru dalam pengembangan AI. Daripada terus memperbesar model dan infrastruktur, peneliti Google justru menemukan cara mengecilkan beban komputasi sambil mempertahankan kualitas hasil. Pendekatan filosofis ini membuka wawasan baru tentang efisiensi teknologi artificial intelligence yang terus berkembang.

Memahami Fondasi Kerja Artificial Intelligence

Untuk memahami signifikansi TurboQuant, kita perlu mengetahui cara kecerdasan buatan benar-benar bekerja di level fundamental. AI tidak membaca kata-kata seperti manusia membaca teks. Sistem ini tidak mengerti bahwa pengguna mengetik “raja”, “cinta”, atau “utang negara” sebagai kata-kata bermakna.

Apa yang sesungguhnya dilihat AI adalah angka—ribuan koordinat dalam ruang matematika berdimensi tinggi yang disebut “vektor”. Setiap kata sederhana diterjemahkan menjadi rangkaian panjang angka-angka presisi tinggi. Semakin kompleks makna suatu kata, semakin panjang daftar angka yang merepresentasikannya. Dengan demikian, setiap percakapan dengan AI pada dasarnya merupakan transaksi angka dalam skala besar.

Masalah Memori yang Menjadi Bottleneck Terbesar

Inilah inti permasalahan yang dihadapi teknologi AI modern: angka-angka itu sangat “mahal” dalam hal memori. Setiap percakapan disimpan dalam struktur yang disebut KV cache, semacam catatan digital yang memungkinkan sistem AI menghindari pembacaan ulang seluruh riwayat percakapan setiap kali memberikan respons.

Namun seperti mahasiswa yang terlalu rajin mencatat, data ini lama-lama memenuhi ruang penyimpanan hingga membuat sistem kelelahan. Di situlah bottleneck terbesar sistem AI modern bersembunyi—bukan pada “otak” pemrosesan data, melainkan pada “ingatan” yang menyimpannya. Masalah memori ini menjadi hambatan serius bagi skalabilitas artificial intelligence.

Teknik Kuantisasi Konvensional dan Kelemahannya

Solusi tradisional yang selama ini digunakan industri adalah kuantisasi, yakni teknik menyederhanakan angka-angka tersebut. Angka presisi tinggi seperti 16.738291 dibulatkan menjadi 17. Analogi yang tepat adalah mengompres foto beresolusi tinggi—beberapa detail hilang, namun wajah masih dapat dikenali.

Sayangnya, teknik lama ini memiliki cacat bawaan yang fundamental. Untuk melakukan kompresi, sistem membutuhkan “biaya tambahan” berupa parameter kalibrasi yang paradoksnya juga memakan memori. Itulah mengapa para ahli menyebutnya seperti “diet sambil ngemil”—berat badan turun sedikit, sementara beban tersembunyi naik diam-diam.

PolarQuant: Pendekatan Elegan Peneliti Google

Inilah tempat tim peneliti Google menawarkan pendekatan yang hampir filosofis. Mereka tidak hanya mengecilkan data, tetapi juga menghapus biaya tersembunyi dari proses pengecilan itu sendiri. Hasilnya adalah solusi yang terdengar seperti trik sulap, padahal sebenarnya matematika tingkat tinggi dengan keanggunan luar biasa.

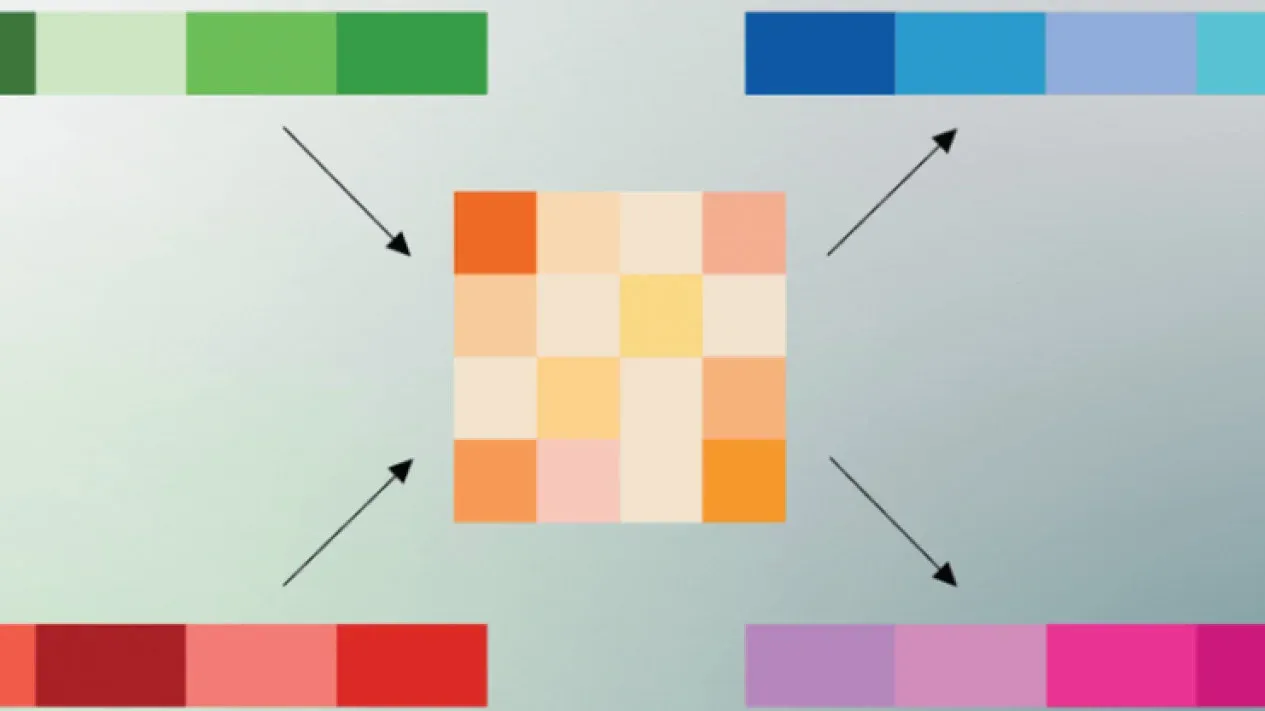

Tahap pertama dalam sistem TurboQuant disebut PolarQuant. Vektor yang sebelumnya disimpan dalam koordinat biasa diputar secara acak untuk menyederhanakan struktur, kemudian diubah menjadi bentuk polar. Bentuk ini menggabungkan dua elemen: “kekuatan makna” (radius) dan “arah makna” (sudut).

Bayangkan sistem lama mengkomunikasikan lokasi sebagai “3 blok ke timur dan 4 blok ke utara”. Pendekatan polar cukup mengatakan “5 blok pada sudut tertentu”. Tujuan akhir tetap sama, namun cara penyimpanannya jauh lebih hemat dan efisien. Dengan pendekatan ini, AI tidak lagi membutuhkan normalisasi yang mahal dalam hal memori.

Data dipetakan ke “lingkaran” dengan batas yang pasti, bukan “kotak” yang terus berubah-ubah. Metafora yang lebih baik adalah perpindahan dari pasar tradisional yang acak ke gudang logistik modern—barangnya identik, tetapi penataannya membuat operasi jauh lebih cepat dan efisien.

QJL: Tahap Kedua untuk Penyempurnaan Data

Namun seperti semua teknik kompresi, selalu tersisa residu kecil berupa kesalahan-kesalahan tipis. Di sinilah tim Google menerapkan tahap kedua yang disebut QJL, singkatan dari Quantized Johnson-Lindenstrauss. Nama ini terdengar seperti mantra kuno dari tekstur matematika, padahal sebenarnya merupakan teorema matematika klasik yang powerful.

Teorema Johnson-Lindenstrauss memiliki kemampuan istimewa: mengizinkan data berdimensi tinggi dipadatkan tanpa merusak hubungan antar titik-titik data. Dengan kata lain, sistem ini mengecilkan data sambil tetap mempertahankan struktur relasional yang penting untuk akurasi AI. Ini adalah solusi yang mengatasi dilema klasik antara efisiensi dan presisi.

Implikasi dan Makna Teknologi TurboQuant

Penemuan TurboQuant memiliki implikasi signifikan untuk masa depan artificial intelligence. Teknologi ini menunjukkan bahwa inovasi tidak selalu berarti membuat sesuatu lebih besar, lebih kuat, atau lebih kompleks. Justru, kejelian dalam merancang sistem yang lebih ringkas namun tetap powerful menunjukkan pemahaman mendalam tentang matematika dan logika komputasi.

Dalam konteks industri teknologi 2026, di mana biaya energi dan infrastruktur cloud terus meningkat, solusi seperti ini menjadi semakin kritis. Sistem AI yang lebih hemat memori berarti biaya operasional lebih rendah, waktu respons lebih cepat, dan aksesibilitas lebih luas bagi perusahaan dengan sumber daya terbatas. Teknologi ini membuka peluang demokratisasi artificial intelligence ke segmen pasar yang lebih luas.

Selain itu, pendekatan yang dikembangkan Google ini menginspirasi peneliti lain untuk berpikir di luar konvensi. Daripada terus berlomba membuat model AI yang lebih besar dengan parameter lebih banyak, komunitas penelitian bisa fokus pada optimisasi cerdas yang menghasilkan efisiensi dramatis. Ini adalah paradigma shift yang potensial mengubah trajectory pengembangan kecerdasan buatan global.

Inovasi TurboQuant dari tim peneliti Google mendemonstrasikan bahwa masa depan artificial intelligence tidak terletak pada magnifikasi tanpa batas, melainkan pada kecanggihan sistematis dalam pengelolaan sumber daya komputasi. Dengan menggabungkan PolarQuant dan QJL, solusi ini menciptakan AI yang lebih ringan namun tetap cerdas—proving bahwa sometimes, less truly is more dalam dunia teknologi.